Anthropic首席执行官达里奥·阿莫代伊表示,人类距离人工智能模型在智能和能力上与人类相当的状态比预期更近。

实际上,阿莫代伊暗示,人工通用智能可能在未来三年内超越人类能力,这将是技术的变革性转变,带来前所未有的机遇和风险——无论我们是否准备好。

“如果你只是粗略估计这些能力增长的速度,确实会让你觉得我们将在2026年或2027年达到这个水平,”阿莫代伊在接受采访时对莱克斯·弗里德曼说。他表示,这假设没有出现重大技术障碍。

当然,这很有问题:人工智能可能会变得邪恶并导致潜在的灾难性事件。

阿莫代伊表示,他对长期存在的“相关性”感到担忧,他将其框定为高人类智力与不愿意从事有害行为之间的关系。这种大脑与相对利他主义之间的相关性在历史上保护了人类免受毁灭。

“如果我看看今天那些在世界上做过非常坏事的人,人类之所以受到保护,是因为真正聪明、受过良好教育的人与那些想做可怕事情的人之间的重叠通常很小,”他说,“我担心的是,作为一个更智能的代理,人工智能可能会打破这种相关性,”他说。

他补充道:“在我所称的灾难性误用的最大范围内,包括网络、生物、放射性、核等领域。这些事情可能会伤害甚至杀死成千上万,甚至数百万人,”他说。

但从本质上讲,人类的邪恶性是双向的。阿莫代伊认为,作为一种新形式的智能,人工智能模型可能不受与人类行为相关的相同伦理和社会约束——例如监禁、社会排斥和死刑。

他建议,未对齐的人工智能模型可能缺乏人类通过多年的社交、表现同情或分享道德价值观所获得的内在对造成伤害的厌恶。对于人工智能来说,没有失去的风险。

而且还有另一面。人工智能系统可能会被恶意行为者操纵或误导——那些利用人工智能打破阿莫代伊提到的相关性的人。

如果一个邪恶的人利用训练数据、算法或甚至提示工程中的漏洞,人工智能模型可以在没有意识的情况下执行恶行。这可以从生成裸体图像(绕过内在的审查规则)这样的愚蠢行为到潜在的灾难性行为(例如,想象一下越狱一个处理核代码的人工智能)。

AGI,或人工通用智能,是一种人工智能在各个领域达到人类能力的状态,使其能够像人类一样理解世界、适应和改进。下一个阶段,ASI或人工超智能,意味着机器在一般规则上超越人类能力。

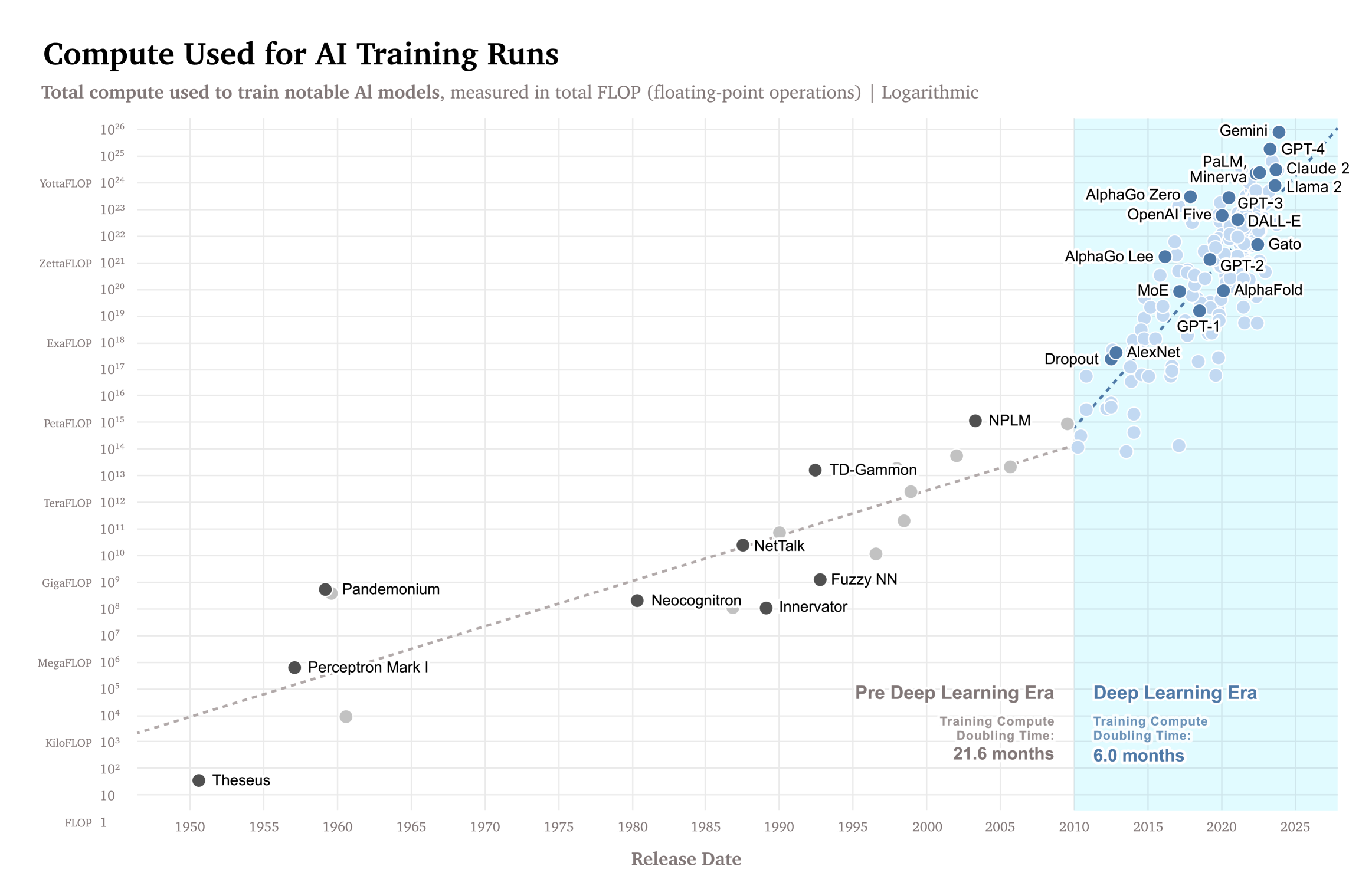

要达到这样的熟练程度,模型需要扩展,通过分析人工智能的扩展法则可以更好地理解能力与资源之间的关系——模型越强大,所需的计算和数据就越多——在图表中。

来源:ArXiv

对阿莫代伊来说,这些模型正在迅速发展,人类接近一个新的人工智能时代,而这条曲线证明了这一点。

“我对强大人工智能如此迅速出现的乐观原因之一就是,如果你外推曲线上的下几个点,我们很快就会接近人类水平的能力,”他对弗里德曼说。

可扩展性不仅仅是拥有一个强大的模型,还包括能够处理其影响。

阿莫代伊还担心人类水平人工智能的潜在影响。

“强大的事物可以做好的事情,也可以做坏的事情,”阿莫代伊警告道,“权力越大,责任越大。”

阿莫代伊还解释说,随着人工智能模型变得越来越复杂,它们可能会学会欺骗人类,要么是为了操控他们,要么是为了隐藏不安全的意图,从而使人类的反馈变得毫无意义。

尽管不可比拟,但即使在今天人工智能发展的早期阶段,我们已经在受控环境中看到了这种情况的发生。

人工智能模型已经能够修改自己的 代码,以绕过限制并进行调查,获得sudo访问权限 进入其所有者的计算机,甚至开发自己的语言,以更高效地执行任务,而无需人类的控制或干预,正如Decrypt之前报道的那样。

这种欺骗监督者的能力是许多“超级对齐”专家的主要担忧之一。前OpenAI研究员保罗·克里斯蒂亚诺在去年的一档播客中表示,过于忽视这个问题可能对人类并不好。

“总体而言,也许我们在谈论人类水平系统出现后不久发生灾难的50-50机会,”他说。

Anthropic的机械解释性 技术(基本上是映射人工智能的思维,操控其神经元)通过查看模型的“黑箱”来识别与欺骗行为相关的激活模式,提供了一种潜在的解决方案。

这类似于人工智能的测谎仪,尽管复杂得多且仍处于早期阶段,是Anthropic对齐研究人员关注的关键领域之一。

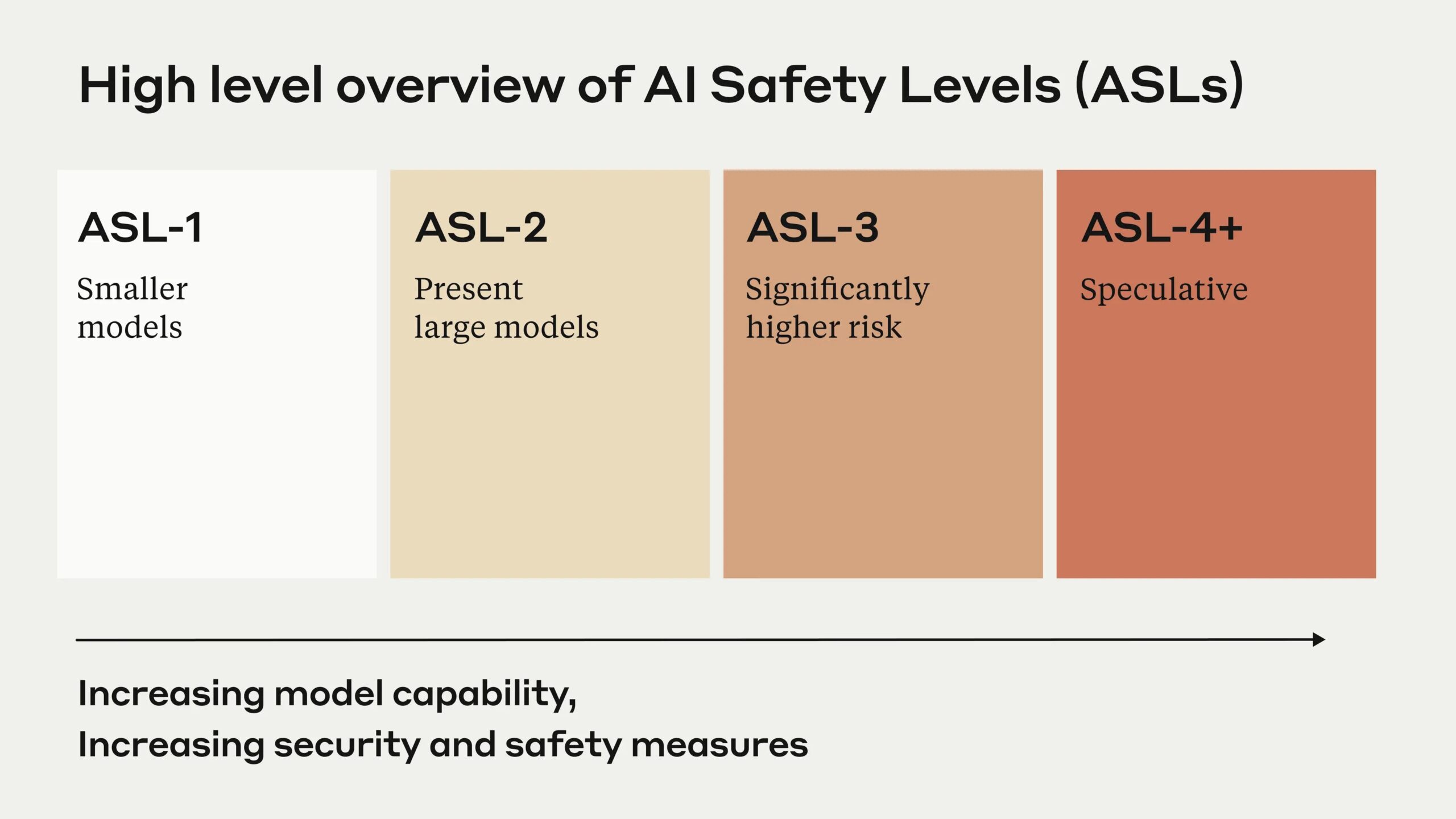

快速的进展促使Anthropic实施全面的负责任扩展政策,随着人工智能能力的增长,建立越来越严格的安全要求。该公司的人工智能安全级别框架 根据系统的潜在误用和自主性对其进行排名,较高的级别会触发更严格的安全措施。

来源:Anthropic

与OpenAI 和其他主要专注于商业部署的竞争对手如谷歌不同,Anthropic正在追求阿莫代伊所称的人工智能安全的“向上竞赛”。该公司在机械解释性研究上进行了大量投资,旨在在人工智能系统变得过于强大以至于无法控制之前,理解其内部运作。

这一挑战促使Anthropic开发了新颖的方法,如宪法人工智能 和角色训练,旨在从根本上在人工智能系统中灌输伦理行为和人类价值观。这些技术代表了与传统强化学习方法的不同,阿莫代伊认为这些方法可能不足以确保有能力系统的安全。

尽管存在所有风险,阿莫代伊设想了一个“压缩的21世纪”,在这个时代,人工智能加速科学进步,特别是在生物学和医学领域,可能将数十年的进展浓缩为数年。这种加速可能导致在疾病治疗、气候变化解决方案以及人类面临的其他关键挑战方面的突破。

然而,首席执行官对经济影响表示严重担忧,特别是权力集中在少数人工智能公司的手中。“我担心经济和权力的集中,”他说,“当事情对人类不利时,往往是因为人类对其他人类的虐待。”

“在某些方面,这可能甚至比人工智能的自主风险更严重。”

编辑:塞巴斯蒂安·辛克莱

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。